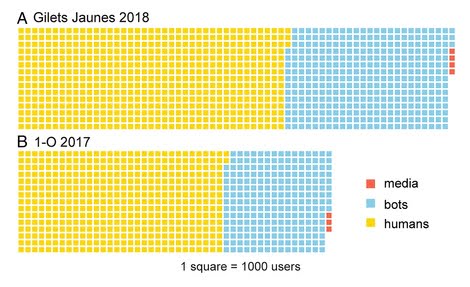

Este año es electoral en América Latina. Ya ha habido primera vuelta de elección presidencial en Ecuador en febrero. Vienen en abril la segunda vuelta y las presidenciales de Perú. Chile enfrenta múltiples comicios: constituyentes, gobernadores, presidenciales, congreso. Una maratón comicial pocas veces vista. Argentina y México tienen elecciones legislativas. En estas circunstancias asoma la cuestión de cuán intrusivas son las campañas de bots, fake news, desinformación en unas elecciones. Funcionarios de alto nivel de Estados Unidos y de la Unión Europea han acusado reiteradamente a Rusia de interferir en sus países durante procesos electorales. Generalmente estas acusaciones se fundan en la presencia de actividades sospechosas desde la oferta; hay menos declaraciones en base a cómo interactúan entre sí. Dos trabajos recientes ponen el foco en la interacción, en qué hacen las personas con la información y los contenidos mediáticos, como sostenía Jesús Martín-Barbero. El primer artículo se titula “Bots are less central than verified accounts during contentious political events” (“Los bots son menos preponderantes que las cuentas verificadas en sucesos políticos conflictivos”), publicado por Sandra González-Bailón y Manlio De Domenico. Los autores tomaron las repercusiones en medios mainstream y en Twitter de los casos de los movimientos de los “chalecos amarillos” (“Gilets Jaunes“) en Francia y el referéndum por la independencia de Cataluña. En ambos procesos, la mayoría de los tuits fueron de seres humanos reconocidos como tales, y luego de bots. Una porción ínfima (1%) fue de tuits de medios.

El trabajo muestra las dificultades de cuantificar el impacto de las campañas de bots en Twitter, en un contexto donde la ciudadanía tiene múltiples plataformas y dispositivos para acceder a las noticias. Se parte que la actividad en Twitter no es representativa de lo que hace la población con los contenidos. Según el trabajo, son las cuentas de personas quienes tienen mayor actividad. Bots y personas interactúan fuerte con los tuis de los medios, que siguen siendo siendo fuente de apelación. Los medios interactúan muy poco entre sí y tienen casi nula relación con bots y personas.

Curiosamente, un número significativo de cuentas bots tienen mayor distribución por la actividad de funcionarios y políticos. Según el trabajo, los medios mainstream siguen siendo influyentes en un escenario muy complejo y diverso de plataformas. Los datos no permiten comprobar que la actividad de desinformación en Twitter por parte de bots sea efectiva.

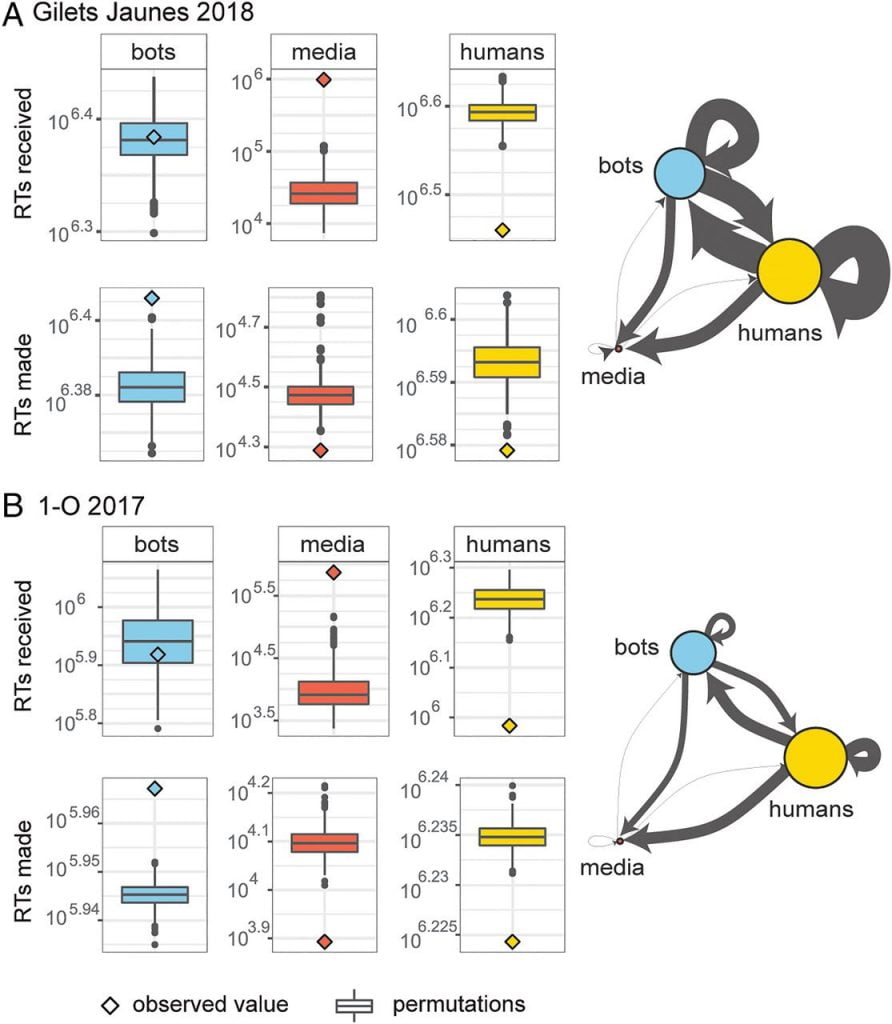

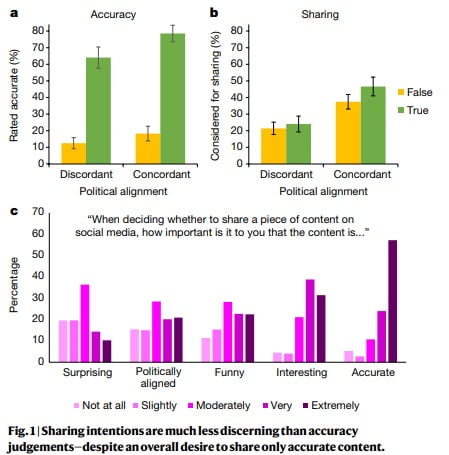

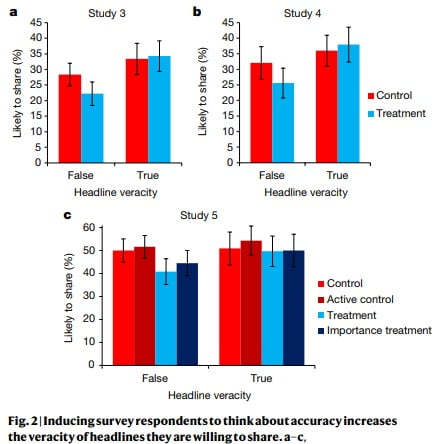

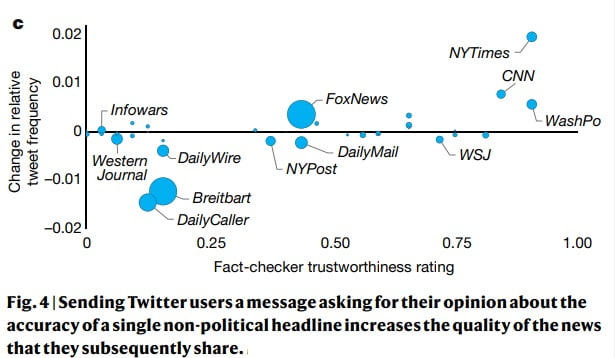

El otro artículo fue publicado en la revista Nature y se titula “Shifting attention to accuracy can reduce misinformation online” (“La atención direccionada hacia la precisión puede reducir la desinformación online”). El trabajo fue desarrollado por Gordon Pennycook, Ziv Epstein, Mohsen Mosleh, Antonio Arechar, Dean Eckles y David Rand. El informe condensa una serie de trabajos realizados en las redes sociales Facebook y Twitter, con personas en Estados Unidos en 2019. Los investigadores partieron en dividir dos acciones: por un lado, percibir un contenido con información precisa y creíble (accuracy) y, por otro, compartir contenidos en las redes. Por ejemplo, en el caso de noticias, las personas tendieron a compartir en redes aquellos titulares que eran creíbles, por sobre los no creíbles y que respondieran a su visión del mundo. Las personas que reciben los contenidos tienen una actitud orientada hacia diferenciar la calidad de los contenidos que reciben, cosa que el artículo da cuenta.

Material de sitios partisans (militantes, de barricada) en Estados Unidos son distribuidos en mucho menor proporción que aquellos de medios mainstream que se consideran creíbles por los fact-checkers. Consumir o leer no implica que sea igual a compartir.

El estudio no niega que las redes sociales tienden a fomentar contenidos rápidos, emocionales y por tanto favorecer el posteo de las fake news y que haya proyectos relativamente organizados de campañas de desinformación. Sin embargo, dado el interés significativo de los miembros en las redes, sugieren que estas podrían implementar un dispositivo colectivo que favorezca la distribución o rotulado de credibilidad. Los autores, sin decirlo, consideran interesante implementar algo similar a los sistemas implementados por sitios como TripAdvisor en vez que la certificación de credibilidad dependa de ONGs que se dediquen al fact-checking.